Ayer Facebook anunciaba la puesta en marcha de varias medidas para combatir las noticias falsas (o desinformación, como Zuckerberg prefiere llamarlas). La puesta en marcha de este plan para atajar las mentiras que corren por esta red social responde a las críticas que ha recibido tras el triunfo de Donald Trump. Después de todo, son muchas las voces que acusan a Facebook de haber tenido un rol decisivo en esta victoria electoral.

Pese a que según Mark c “el 99% de las historias que se comparten en Facebook son veraces. Solo una pequeña cantidad es falsa o con noticias inventadas”, muchos dicen que las noticias falsas que el equipo de Trump hizo circular por la red social, como que el papa Francisco le daba su apoyo, y la importante suma de dinero invertida en publicidad, pudieron tener un papel decisivo en la victoria republicana.

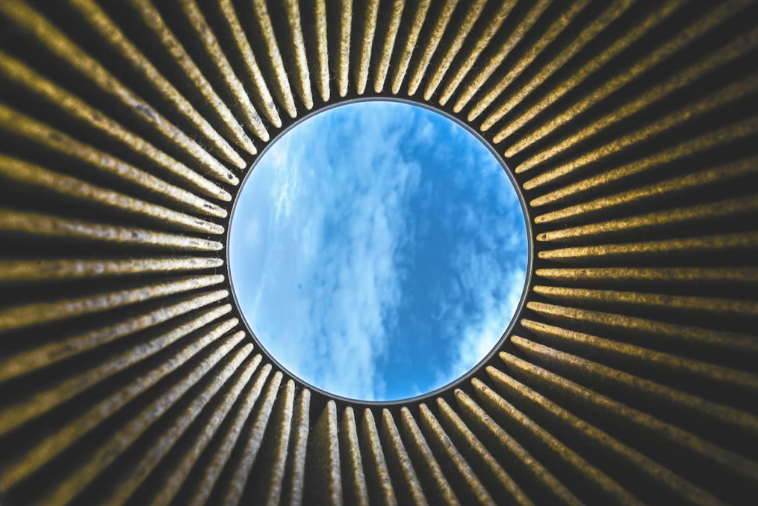

Más allá de la veracidad de la información que corre por Internet, en esta historia del papel que ha tenido Facebook en la victoria de Trump hay otro aspecto que vale la pena destacar: la existencia de la burbuja de filtros de la que ya advirtió Eli Pariser. Pese a que Internet permite el acceso sin fronteras a toda la información, vivimos inmersos en “nuestra realidad”: existe una burbuja de filtros que obstaculiza el acceso a esa información “que podría desafiar o ampliar nuestra visión del mundo”, en palabras de Pariser.

[Tweet «Internet permite acceder a toda la información, pero vivimos inmersos en nuestra burbuja de filtros.»]

¿Quién es el responsable de estos filtros? Los algoritmos. Facebook, pero también Google, Twitter y todas las herramientas digitales nos ofrecen una “experiencia personalizada” según nuestros gustos e intereses. Y esto puede tener una lectura positiva: te ofrecen los contenidos que (creen que) quieres, en base a tu actividad digital. Pero la otra cara de la moneda es más oscura: si interactúas poco con las publicaciones de ciertos “amigos” de Facebook, pronto verás cómo sus actualizaciones desaparecen de tu timeline. Dejarás de estar informado sobre ellos. Y esto es extensible a cualquier otro emisor: medios de comunicación, marcas, partidos políticos… El resultado: acabas viendo solo los contenidos más acordes con tu forma de pensar, inmerso en tu burbuja de realidad.

Esto no es algo nuevo: la teoría de la comunicación hace años que nos explica que hay sesgos de atención selectiva y que consumimos los medios que refuerzan nuestra forma de entender el mundo. ¿O es que aún hay alguien que crea en la objetividad de los medios?

La burbuja de filtros influye en nuestra forma de percibir la realidad y también pone en peligro la democracia, alerta Wired (algo que también advirtió Pariser). El caso Trump no es el único en el que se pueden ver los efectos de esta filter bubble: el Brexit es otro buen ejemplo.

Ya lo dijo el propio Zuckerberg: “Una ardilla muriendo frente a tu casa puede ser más relevante para ti ahora mismo que la gente muriendo en África”. Las herramientas digitales creen saber lo que nos interesa en cada momento y no es fácil escapar de estas burbujas de filtros, pero lo importante es ser conscientes de que existen y de que están modelando nuestra forma de ver el mundo.

Al fin y al cabo, y como ya he comentado en otros posts, Internet no cambia tanto las cosas como a veces queremos creer. Ni accedemos a toda la información que tenemos a golpe de clic ni compartimos nuestra opinión si sabemos que es minoritaria. Las herramientas digitales permiten cambiar muchas cosas, otra cosa es que nosotros cambiemos algo.

[Actualización 23/11/16: interesante análisis de Ferran Lalueza, profesor de la UOC: #DonaldTrumpWins #TheTruthLoses]

[Tweet «Las herramientas digitales permiten cambiar muchas cosas, otra cosa es que nosotros cambiemos algo.»]